Lager kosten=groei; Jevons Paradox

De afgelopen tijd heb ik een aantal keer Jevons paradox gebruikt in presentaties rond cloud.

Het idee en concept achter Jevons paradox in combinatie met cloud computing komt volledig uit de koker van Simon Wardley.

Voor die gene die zijn briljante presentatie(s) nog niet eerder hebben gezien:

In zijn verhaal gebruikt hij vaak het voorbeeld van product naar diensten (services/utility) ontwikkeling.

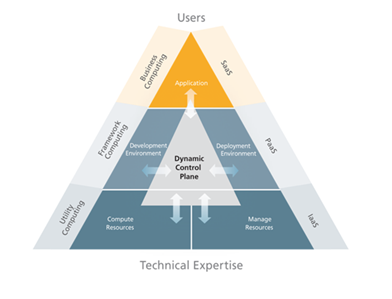

Deze zien we terug bij de ontwikkeling van elektra. Deze gaat van de uitvinding van elektra en zijn mogelijkheden (innovatie), via Custom Build waarbij iedereen zijn eigen elektra opwerkte naar Utility levering waarbij we elektra uit de muur kunnen halen en ons niet meer druk maken over wat er eigenlijk allemaal ‘onder’ zit.

Deze ontwikkeling zien we ook terug bij de PC en ook bij de ontwikkeling van CRM. Daarbij zijn we gegaan van custom CRM systemen naar Salesforce vandaag de dag.

Als we de curve omhoog volgen zien we ook dat het product wat deze ontwikkeling volgt, steeds meer standaard word. Hierbij hebben we het dan over het toepassen van (internationale) standaarden, maar ook het feit dat een product zo algemeen beschikbaar is dat deze je als organisatie geen concurrentie voordeel meer beid; iedereen heeft het of kan het kopen.

Het zorgt er ook voor dat men de Utility tegen lager kosten kan af nemen of tegen een pay-per-use model. Hier door word het product beschikbaar voor een grotere groep mensen of bedrijven.

We zien ook dat het product dat een Ultility en zo algemeen beschikbaar, weer een nieuwe golf van innovatie teweeg brengt.

Bij de ontwikkeling van elektra was dit ook te zien; mensen en bedrijven behoefde niet langer te investeren in eigen ‘energie centrales’ waar door de consumptie voor meer mensen mogelijk werd en de consumptie van het product omhoog ging.

Jevons paradox

De toepassing van Jevons paradox op deze ontwikkeling zegt (op hoofdlijnen), dat als de kosten omlaag gaan de consumptie van het product stijgt.

Deze paradox is ook van toepassing op diverse IT ontwikkelingen.

Een uitstekend voorbeeld wat ik in de praktijk diverse malen mocht tegen komen is de inzet van virtualisatie.

Door de time-to-market te verlagen naar 2 dagen (van 6 weken) en de kosten te verlagen (soms met 75%) per te leveren server, kon er meer gedaan worden aan IT innovatie tegen lager kosten dan voorheen.

Hier door steeg de vraag naar een virtuele server explosief.

Dit fenomeen, wat ook wel bekend is als VM-sprawl, kun je zien als iets negatiefs maar dat is het zeker niet. Als jij de business kan helpen met snellere

innovatie tegen lager kosten, dan doe je het juist heel goed.

Daar waar de business dacht slechts 3 innovaties te kunnen door voeren dat jaar… en het worden er nu 7… dan lever jij een concurrentie voordeel voor jou

organisatie t.o.v. de rest van de markt.

Jevons paradox en Cloud

Jevons paradox is ook van toepassing op cloud computing.

Met cloud computing word het gebruik van 1000-en compute nodes beschikbaar voor iemand met slechts een credit card. En als hij klaar is… dan betaald hij ook niets meer. En dat zonder torenhoge start kosten om die nodes te moeten kopen, bouwen en onderhouden.

Deze manier van levering en het feit dat het ontzettend toegankelijk is, zullen zorgen voor een explosieve groei op dit vlak.

De meeste organisaties vandaag de dag, zitten vast in hun huidige complexiteit en hoge beheerskosten. Hier door is er weinig tot geen ruimte meer voor innovatie.

Door de onderliggende lagen van de IT infrastructuur als een utility af te nemen, zodat men zich hier niet langer druk over hoeft te maken, kan men ruimte creëren voor nieuwe innovatie.

Dit alles betekend echter dat op langere termijn de complexiteits uitdagingen zich zullen verplaatsen naar de hogere lagen van de IT Stack.

Dat is ook de plek waar we vandaag de dag een hele boel uitdagingen hebben waar we niet echt goed aan toe kwamen. Denk bijvoorbeeld aan de explosieve data groei.

Christian Belady (Microsoft) paste recent ook Jevons paradox toe op de ontwikkeling van de datacenter markt. De afgelopen jaren kende de markt voor bouw en ontwikkeling van datacentra een expolieve groei;

Christian Belady (Microsoft) paste recent ook Jevons paradox toe op de ontwikkeling van de datacenter markt. De afgelopen jaren kende de markt voor bouw en ontwikkeling van datacentra een expolieve groei;

Jevons’ Paradox has been one of the reasons given for the incredible growth we are seeing with online services. The explosion of services now available on the internet has fueled one of the fastest growing industries today: Datacenter construction.

Dit alles is ook logisch omdat al die cloud omgevingen wel ergens gehuisvest moeten worden. Aangezien het verbruik zal toenemen, zullen er ook meer (of grotere) datacentra gebouwd moeten worden om aan al deze vraag te kunnen voldoen.

Uiteindelijk zal al deze ontwikkeling er voor zorgen dat vele (niet ICT) organisaties een volgende stap kunnen maken in hun eigen innovatie en ontwikkeling. Dit alles ondersteund door IT, die niet langer een beperking is maar een katalysator.

En over 10 jaar? Dan zitten we weer om de tafel; om de complexiteit in de hogere lagen van de IT stack op te lossen… ICT blijft een mooi vak 😉